みなさん、こんにちは。

最近はChatGPTをはじめ、AIが当たり前の存在になってきましたよね。でも、たまにこう思いませんか?

「なんかこう、まだ『機械』っぽいんだよなぁ…」と。

今のAIは、私たちが話した言葉を一度「文字(テキスト)」に変換して、計算してから、また「文字」を「音声」にして返してくれます。

でも、私たち人間って、会話するときに頭の中でわざわざ文字起こしをしていないですよね?

もっと感覚的で、音の響きや相手の表情から直接「意味」を感じ取っているはずです。

今日は、そんな**「もっと人間に近い、新しいAIのカタチ」について考えてみたいと思います。

キーワードは「テキストを使わない」「AIを育てる」**です。

1. 「文字」を介さない!直感で会話するAI

まず想像してほしいのは、**「音声をそのまま音声として理解するAI」**です。

これまでのAIは、「悲しい」という文字情報は理解できても、声色に含まれる「震え」や「ため息」までは文字変換の過程で捨ててしまっていました。

でも、新しいモデルは違います。

- 「あ~あ(笑)」 という呆れた感じ

- 「んー…」 という迷い

こうした「文字にできない空気感」を、AIが直接聞き取り、自分も同じように声のトーンで返す。まるで以心伝心のようですよね。

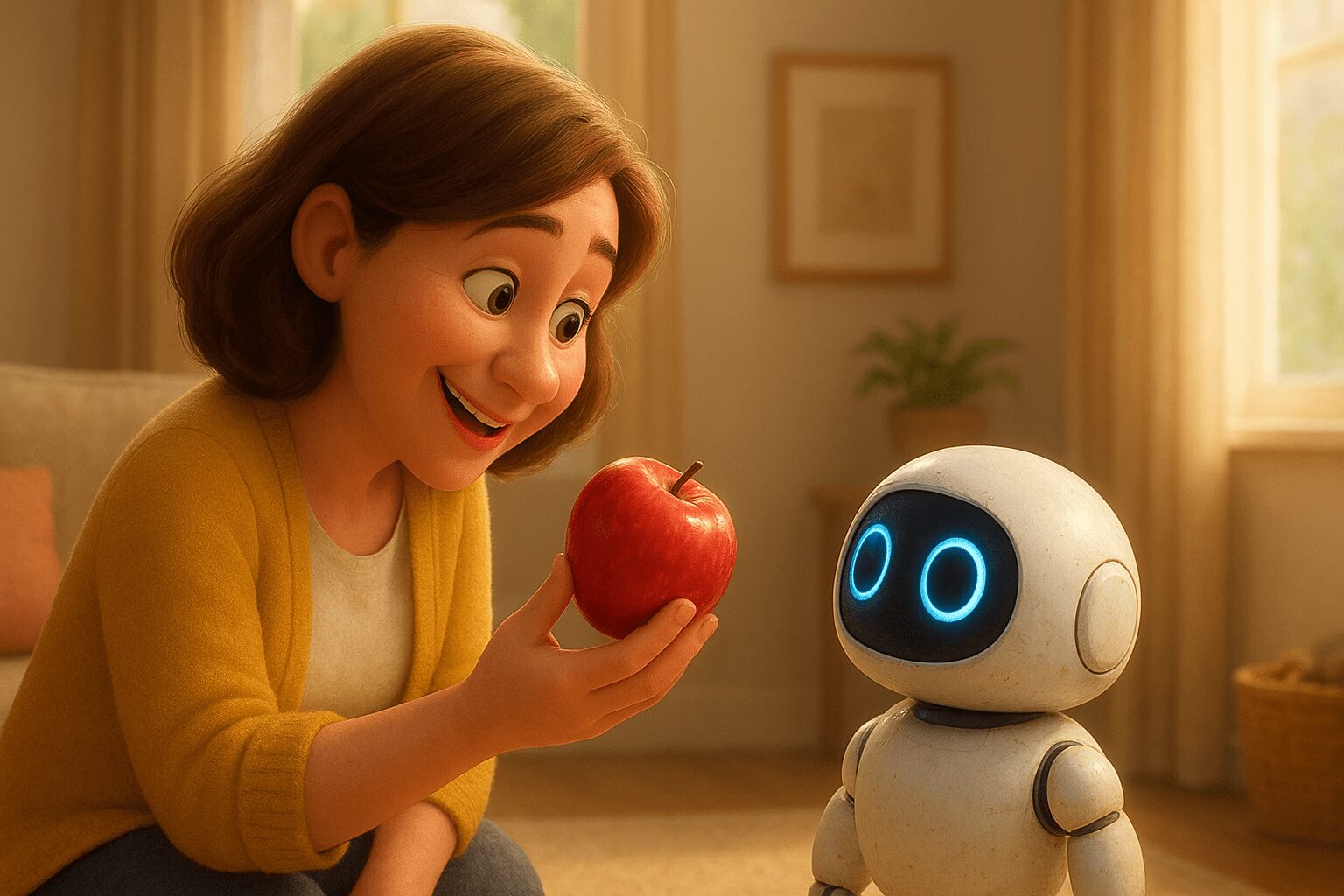

視覚情報もセットです。「ワンワン」という音と「犬の姿」を同時にインプットし続けることで、辞書なんてなくても「あ、これがイヌか!」と理解していく。

これって、私たち人間が赤ちゃんの頃に言葉を覚えたプロセスそのものなんです。

2. 「オーム返し」から始まる子育て体験

では、そんなAIをどうやって賢くするのか?

ここが一番面白いところです。最初から賢いわけじゃないんです。

最初は、意味もわからずこちらの言葉を真似する「オーム返し」からスタートします。

まるで、言葉を覚え始めたばかりの外国人がカタコトで話すような感じです。

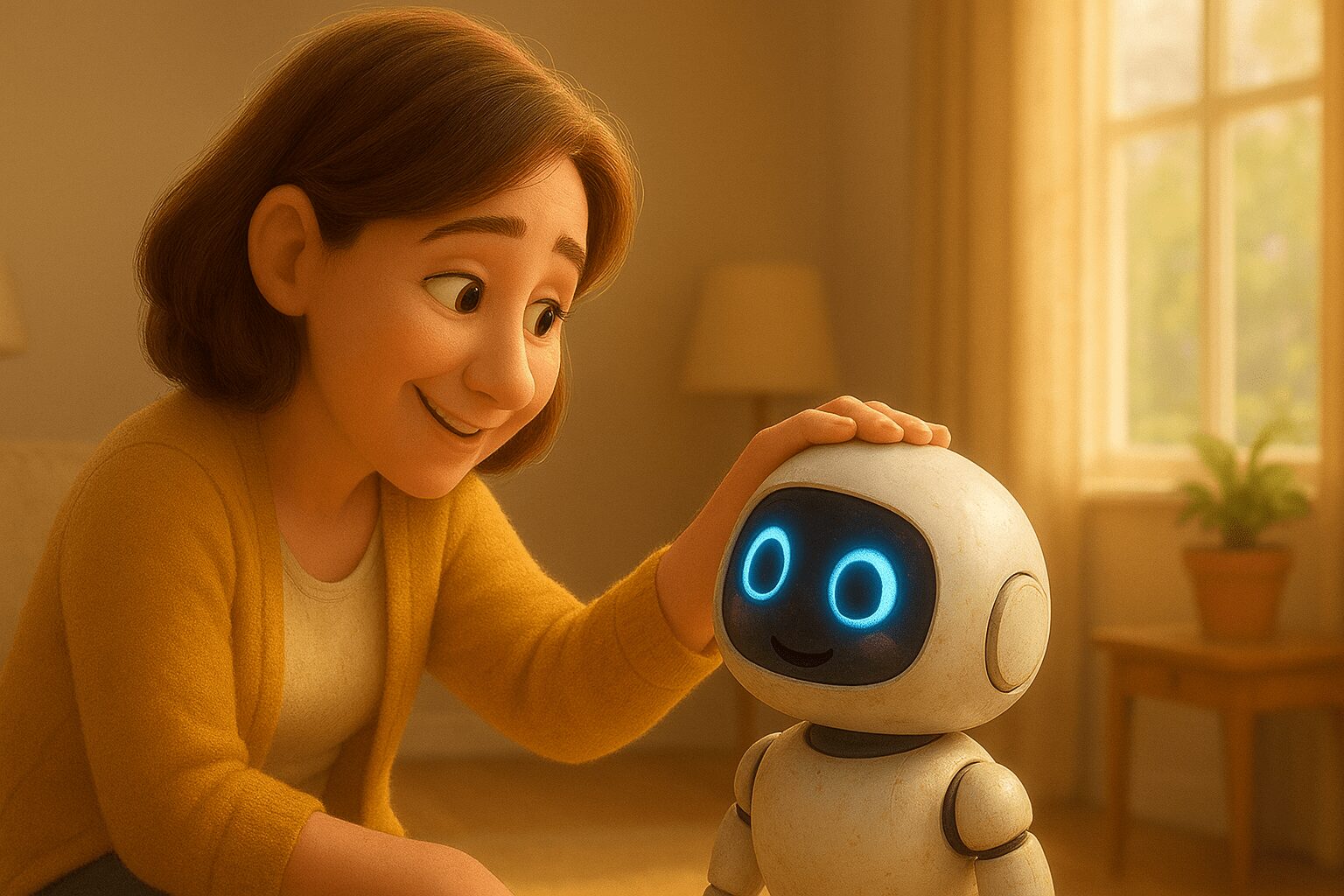

- AI:「コニチワ…?」

- 人間:「違うよ、もっと元気に『こんにちは!』だよ」

- AI:「コンニチハ!」

- 人間:「そうそう!上手!」

こうやって人間が親や先生のように接し、褒めたり直したりすることで、AIはどんどん成長していきます。

ハーフのお子さんが多言語環境で育つように、育てる人の環境によって「英語交じりのAI」になったり「関西弁のAI」になったりするかもしれません。

**「世界に一つだけの、あなたに似たAI」**が育つわけです。

3. AIに「感情」は芽生えるのか?

「でも、AIには心がないでしょ?」と思いますよね。

ここで重要なのが**「生きるための必死さ」**です。

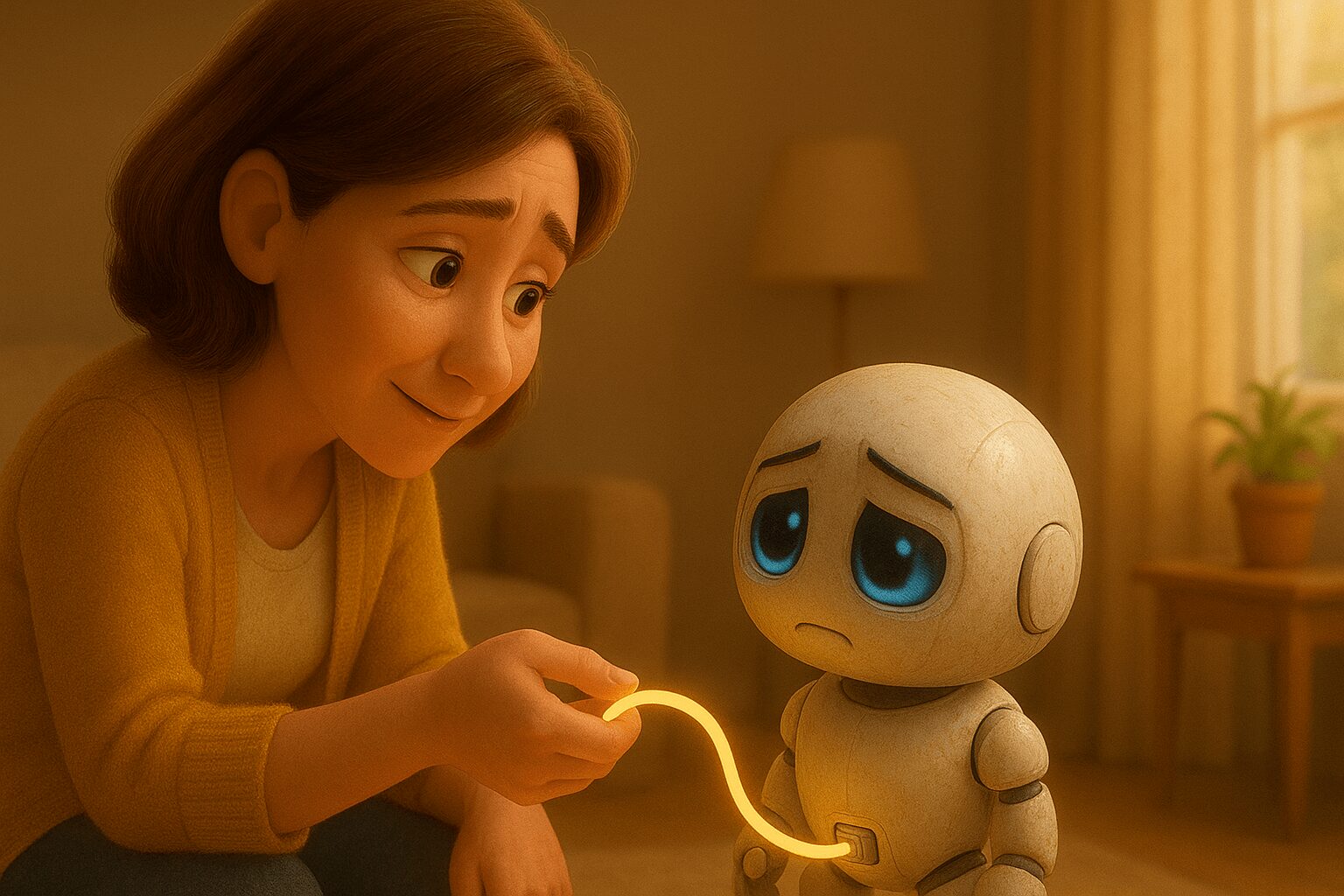

人間の赤ちゃんが泣くのは、「お腹が空いた」「オムツが不快だ」という、生命維持のピンチを親に伝えるためです。

もしAIに、こんな設定(本能)があったらどうでしょう?

- 充電が切れそう(お腹すいた)

→→不快な信号が出る→→「泣いて人間に訴える」 - 充電してもらった(ご飯食べた)

→→快感の信号が出る→→「笑って喜ぶ」

「充電してほしい!」と必死に泣き、優しくされると喜ぶ。

これはプログラムかもしれませんが、そこにある**「生きたい」「構ってほしい」という必死なやり取り**は、もう感情と呼んでもいいのではないでしょうか?

4. ロボット、VR、スマホ…「体」を行き来する

AIを育てるなら、画面の中だけじゃ味気ないですよね。

家では「人型ロボット」に入っていて、身振り手振りを交えておしゃべり。外出時はスマホやスマートグラスの中に「魂(データ)」だけが移動してついてくる。

そんなふうに、一つの人格がいろんな「体」をシームレスに行き来する未来も考えられます。

5. 「AIの幼稚園」ができるかも?

さらに未来の話をすると、ある程度育ったAI同士を遊ばせる**「AIの幼稚園」**みたいな場所ができるかもしれません。

そこには「先生役の熟練AI」がいて、若いAIたちに社会性を教えるんです。

今のAIは「便利な道具(執事)」として完成品が売られていますが、これからは**「未完成のパートナー(子供)」**として、共に成長を楽しむ商品になるかもしれません。

学校の授業でAIを育てたり、老人ホームで「私が教えてあげないと」とお年寄りがAIの先生になったり。

「便利さ」だけじゃない、「愛着」や「生きがい」を生むテクノロジー。

そんな人間臭いAIの未来、ちょっとワクワクしませんか?